Semua orang sedang membicarakan AI terbaru dan kekuatan jaringan neural, tetapi lupa bahwa kinerja perangkat lunak sangat tergantung pada perangkat keras yang digunakan. Menurut Profesor Teknik Elektro dan Komputer University of Southern California (USC), Joshua Yang, perangkat keraslah yang telah menjadi “penghambat” saat ini.

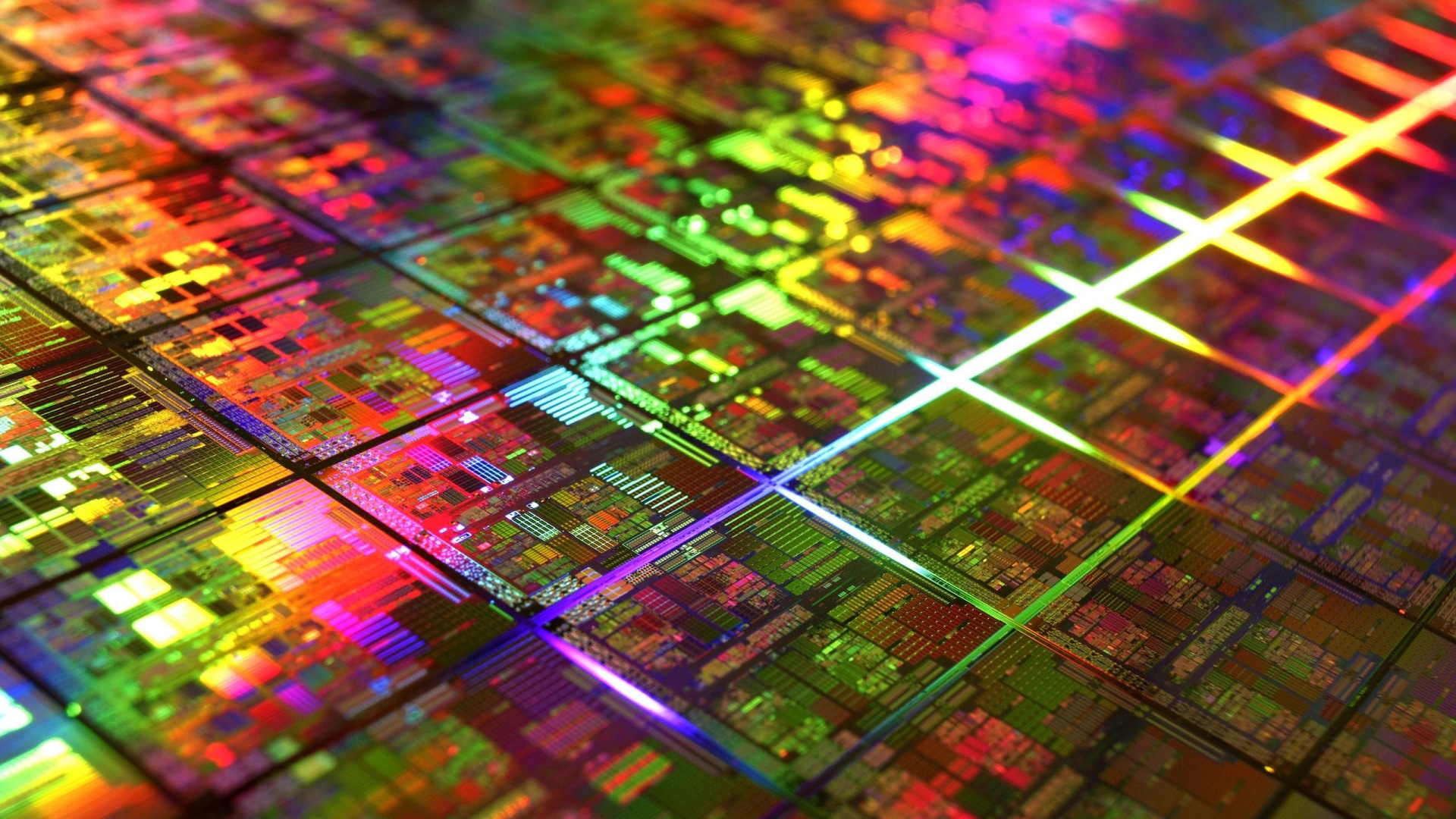

Sekarang, penelitian Prof. Yang dan rekan-rekannya mungkin dapat mengubah hal tersebut. Mereka percaya bahwa mereka telah mengembangkan jenis chip baru dengan memori terbaik yang pernah ada untuk edge AI (AI di perangkat portabel).

Selama sekitar 30 tahun terakhir, ketika ukuran jaringan neural yang dibutuhkan untuk aplikasi AI dan pengolahan data mengalami peningkatan setiap 3,5 bulan, kemampuan perangkat keras yang dibutuhkan untuk memprosesnya baru mengalami peningkatan setiap 3,5 tahun. Menurut Prof. Yang, perangkat keras menjadi masalah yang semakin parah.

Pemerintah, industri, dan akademisi mencoba mengatasi tantangan ini di seluruh dunia. Beberapa terus bekerja pada solusi perangkat keras dengan chip silikon, sementara yang lain mencoba bereksperimen dengan jenis bahan dan perangkat baru.

Pekerjaan Prof. Yang termasuk di tengah-tengahnya. Fokusnya adalah memanfaatkan dan menggabungkan kelebihan dari bahan baru dan teknologi silikon tradisional yang dapat mendukung perhitungan AI dan pengolahan data yang berat.

***

Artikel baru peneliti dalam jurnal Nature berfokus pada pemahaman fisika dasar yang mengarah ke peningkatan drastis dalam kapasitas memori yang diperlukan untuk perangkat keras AI. Tim Prof. Yang, dengan peneliti dari USC (termasuk grup Han Wang), MIT, dan Universitas Massachusetts, mengembangkan protokol untuk perangkat yang mengurangi “noise” dan menunjukkan praktik penggunaan protokol ini dalam chip terintegrasi (SoC).

Demonstrasi ini dilakukan di TetraMem, sebuah perusahaan startup yang didirikan oleh Yang dan co-authors-nya (Miao Hu, Qiangfei Xia, dan Glenn Ge), untuk memasarkan teknologi percepatan AI.

Menurut Yang, chip memori baru ini memiliki kepadatan informasi tertinggi per perangkat (11 bit) di antara semua teknologi memori yang diketahui sejauh ini. Perangkat kecil namun kuat seperti itu dapat berperan penting dalam memberikan kekuatan yang luar biasa pada perangkat yang kita miliki.

Chip tersebut bukan hanya untuk memori, tapi juga untuk prosesor. Jutaan chip kecil tersebut, yang bekerja secara paralel untuk menjalankan tugas AI Anda dengan cepat, mungkin hanya memerlukan baterai kecil untuk memberinya daya.

***

Chip yang dibuat oleh Yang dkk menggabungkan silikon dengan memristor oksida logam untuk menciptakan chip yang kuat namun tidak menghabiskan banyak energi. Teknik ini berfokus pada penggunaan posisi atom untuk merepresentasikan informasi daripada jumlah elektron (yang merupakan teknik saat ini dalam komputasi pada chip).

Posisi atom menawarkan cara yang kompak dan stabil untuk menyimpan lebih banyak informasi secara analog, bukan digital. Selain itu, informasi dapat diproses di tempat penyimpanannya tanpa harus dikirim ke salah satu “processor” yang didedikasikan khusus, sehingga menghilangkan antrian proses (bottle neck) yang ada dalam sistem komputasi saat ini. “Dengan cara ini, energi untuk komputasi AI

lebih efisien dengan throughput yang lebih tinggi,” kata Prof. Yang.

Bagaimana caranya?

Prof. Yang menjelaskan bahwa elektron yang dimanipulasi dalam chip tradisional adalah “ringan”. Keringanan ini membuat mereka rentan untuk bergerak dan lebih mudah menguap. Alih-alih menyimpan memori melalui elektron, Prof. Yang dkk menyimpan memori dalam atom penuh. Inilah mengapa memori ini penting.

Biasanya, ketika seseorang mematikan komputer, informasi yang tersimpan di memori (RAM) akan hilang — tetapi jika Anda menjalankan komputasi baru dan komputer Anda membutuhkan informasi itu lagi, Anda telah kehilangan waktu dan energi karena komputer harus memuat ulang informasi tersebut.

Metode baru ini, fokus pada mengaktifkan atom daripada elektron, tidak memerlukan daya baterai untuk menjaga informasi yang disimpan. Skenario serupa terjadi dalam komputasi AI, di mana memori stabil yang mampu menghasilkan kepadatan informasi yang tinggi sangat penting.

Teknologi baru ini memungkinkan kemampuan AI yang kuat dalam perangkat edge, seperti Google Glasses, yang sebelumnya mengalami masalah efisiensi daya.

Selain itu, dengan mengubah chip agar mengandalkan atom daripada elektron, chip menjadi lebih kecil. Prof. Yang menambahkan, dengan metode baru ini ada lebih banyak kapasitas komputasi pada skala yang lebih kecil.

Selain itu, metode ini, dapat menawarkan “banyak tingkat memori untuk membantu meningkatkan kepadatan informasi”.

Untuk menjelaskan konteksnya, saat ini ChatGPT berjalan di cloud. Inovasi baru ini, diikuti dengan beberapa pengembangan lebih lanjut, dapat menempatkan kekuatan mini versi ChatGPT pada perangkat pribadi setiap orang.

Ini dapat membuat teknologi yang sangat canggih lebih terjangkau dan dapat diakses untuk berbagai aplikasi.

Sumber

New chip design to provide greatest precision in memory to date

Add comment